Anthropic запустила Code Review у Claude Code для перевірки ШІ-згенерованого коду

Anthropic запустила інструмент Code Review у Claude Code. Він перевіряє код у pull request, тобто в запитах на внесення змін до проєкту, і має знаходити помилки ще до того, як їх додадуть до основної кодової бази. Спочатку функція доступна в дослідницькому прев’ю для клієнтів Claude for Teams і Claude for Enterprise.

У компанії пояснюють запуск тим, що генеративні інструменти пришвидшили написання коду, але водночас збільшили кількість змін, які командам треба перевіряти вручну. Anthropic заявляє, що обсяг коду на одного інженера всередині компанії за рік виріс на 200%, а рев’ю стало вузьким місцем у процесі розробки.

За словами керівниці продукту Anthropic Кет Ву, Code Review орієнтований насамперед на великі команди, які вже активно працюють із Claude Code. Вона сказала TechCrunch, що компанії на кшталт Uber, Salesforce та Accenture шукають спосіб швидше перевіряти велику кількість pull request, які створюються за допомогою ШІ.

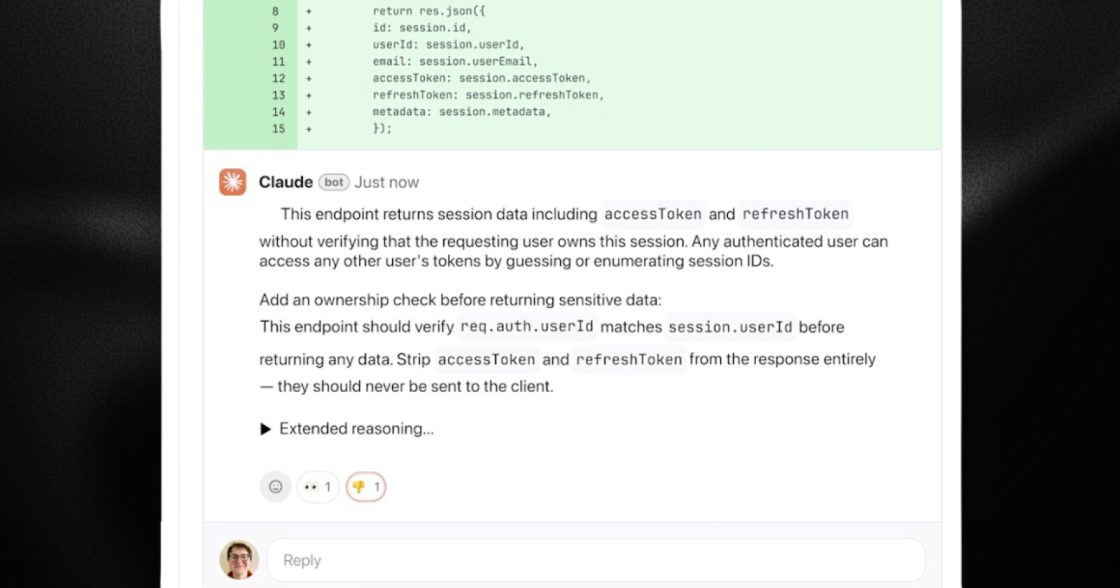

Anthropic робить акцент не на стилі коду, а на логічних помилках. Компанія також додає позначки серйозності: червоний колір для найкритичніших проблем, жовтий — для потенційних ризиків, фіолетовий — для помилок, пов’язаних зі старим кодом або давніми збоями.

Інструмент працює на багатoагентній системі. Кілька агентів паралельно аналізують код з різних боків, а фінальний агент збирає результати, прибирає дублікати й визначає, що є найважливішим. За даними Anthropic, середня перевірка триває близько 20 хвилин, а для великих змін система підключає більше агентів і робить глибший аналіз.

У компанії кажуть, що вже використовують Code Review майже для кожного pull request. До запуску інструмента змістовні коментарі отримували 16% pull request, а тепер — 54%. На великих pull request із понад 1000 змінених рядків система знаходила проблеми у 84% випадків, у середньому по 7,5 зауваження на один запит.

Code Review не ухвалює зміни замість людини. В Anthropic підкреслюють, що фінальне рішення все одно залишається за командою розробки.

Інструмент також дає базовий аналіз безпеки, а технічні керівники можуть додавати власні перевірки відповідно до внутрішніх правил команди. Для глибшого аналізу безпеки Anthropic пропонує окремий продукт Claude Code Security.

Окремо TechCrunch зазначає, що запуск Code Review відбувся в момент, коли Anthropic посилює ставку на корпоративний напрям. Видання пише, що підписки компанії з початку року зросли в чотири рази, а річний темп виручки Claude Code після запуску перевищив $2,5 млрд — за даними самої Anthropic.

Джерело: TechCrunch