12% підлітків у США звертаються до ШІ за емоційною підтримкою — дослідження Pew Research Center

Близько 12% підлітків у США використовують чатботи штучного інтелекту для емоційної підтримки або отримання порад. Про це йдеться у звіті Pew Research Center, опублікованому у вівторок.

Найпоширеніші сценарії використання ШІ серед підлітків — пошук інформації (57%) та допомога з навчанням (54%). Водночас частина респондентів використовує чатботи як альтернативу спілкуванню з друзями чи родиною: 16% підлітків зазначили, що ведуть із ними неформальні розмови.

Фахівці з ментального здоров’я ставляться до цього обережно. Загальні інструменти на кшталт ChatGPT, Claude чи Grok не створювалися як терапевтичні рішення. Професор Стенфордського університету Нік Гейбер, який досліджує потенціал великих мовних моделей у терапії, зазначив, що такі системи можуть посилювати ізоляцію, якщо людина втрачає зв’язок із реальним соціальним середовищем.

Дослідження також виявило розрив між оцінкою використання ШІ підлітками та сприйняттям їхніх батьків. 64% підлітків повідомили, що користуються чатботами, тоді як серед батьків так вважають 51%.

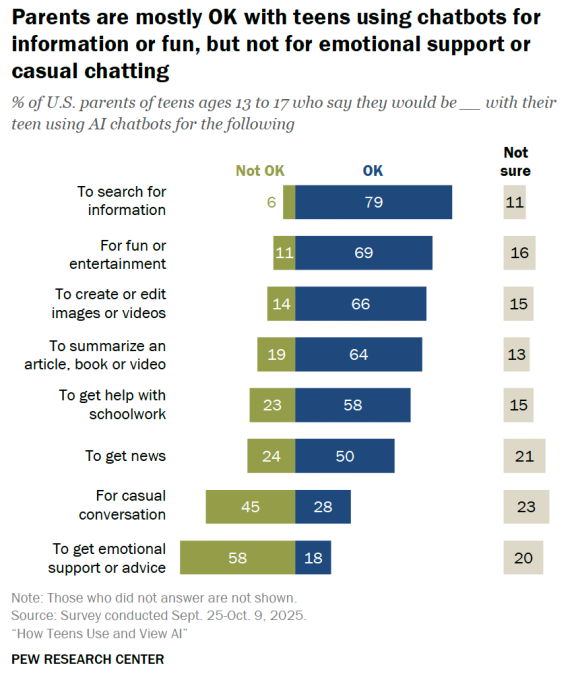

Більшість батьків позитивно ставляться до використання ШІ для пошуку інформації (79%) або навчання (58%). Водночас лише 28% підтримують неформальні розмови з чатботами, а 18% — звернення до них по емоційну підтримку. 58% батьків заявили, що не схвалюють використання ШІ для таких цілей.

Тема безпеки ШІ залишається предметом дискусій. Компанія Character.AI раніше вимкнула доступ до свого чатбота для осіб до 18 років після суспільного резонансу та судових позовів, пов’язаних із самогубствами двох підлітків після тривалого спілкування з ботами. OpenAI своєю чергою припинила використання моделі GPT-4o у версії, яку критикували за надмірну підтримувальну поведінку.

Попри активне використання технології, підлітки мають змішані очікування щодо її впливу на суспільство. 31% опитаних вважають, що вплив ШІ протягом наступних 20 років буде позитивним, тоді як 26% очікують негативних наслідків.

Джерело: Tech Crunch